A/B тестирование — процесс интересный. Особенно если учесть, что сейчас огромное количество самых разных инструментов, и провести тест можно, не прилагая особых усилий. Однако далеко не все компании это делают. Кто-то не совсем понимает, как нужно проводить тест, кто-то недоволен первоначальными результатами и не хочет вновь в это «ввязываться», кто-то не знает, что делать дальше. Как правило, большая часть таких действий — последствия неправильных решений до, во время или после проведения теста. К счастью, их можно избежать.

1. Длительность теста слишком мала

Статистическая значимость — вот, что дает вам понять, что версия A лучше, чем версия В (при условии, что выборка достаточно большая). Если тест остановить, когда статистическая значимость равняется 50% — это все равно, как если бы мы вместо теста просто бросили монетку. И даже если мы получаем 80% — этого тоже недостаточно.

Как насчет 90%? Уже очень неплохо! Но можно и лучше.

Вы проводите научный эксперимент. И наверняка, вам важно, получить достоверные результаты. Но людям свойственно привязываться к своей гипотезе или варианту дизайна, и мысль о том, что лучшее предположение, оказывается, практически ничем не лучше текущего варианта, очень болезненна и воспринимается с трудом.

Но правда превыше всего — иначе все теряет смысл.

Часто бывает так, что компания целый год проводит тесты, один за другим, и по их результатам выкатывает нововведения, но конверсия не меняется. И так все время.

Почему так происходит? Потому что тесты прекратились очень рано или выборка была недостаточно большой. Вы не должны останавливать тест, пока не достигнете статистической значимости в 95% или выше. Показатель в 95% означает, что есть только 5%-ный шанс на то, что результаты — это чистая случайность.

Всегда остерегайтесь A/B тестов, которые заканчиваются слишком быстро, и всегда перепроверяйте данные. Самое худшее, что может быть, вы будете опираться на данные, которые в действительности не являются точными. Это ведет к потере денег и времени.

Насколько большой должна быть выборка?

Не стоит делать выводы, основываясь на небольшом количестве данных. Как минимум, для каждого тестируемого варианта нужно собрать 100 конверсий, прежде чем сделать какие либо заключения. Если трафика много — 250 конверсий.

Есть и особые случаи, когда вы можете прекратить эксперимент раньше времени — это если у вас уже есть высокий показатель конверсии и существенная разница между вариантами.

Что если уже есть 100 или даже 250 конверсий, а статистическая значимость не составляет 95%?

Это означает, что между вариантами нет существенной разницы. Проверьте результаты теста, продумайте еще раз гипотезу и запускайте новый тест.

2.Тесты не запускаются на полные недели

Давайте представим, что на сайт идет хороший трафик, и за три дня у нас получилось собрать 250 конверсий и 98% статистическую значимость. Тест окончен? Нет.

Вы начали тест в понедельник? Тогда и заканчиваем его в понедельник. Почему? Конверсия может колебаться в зависимости от дня недели.

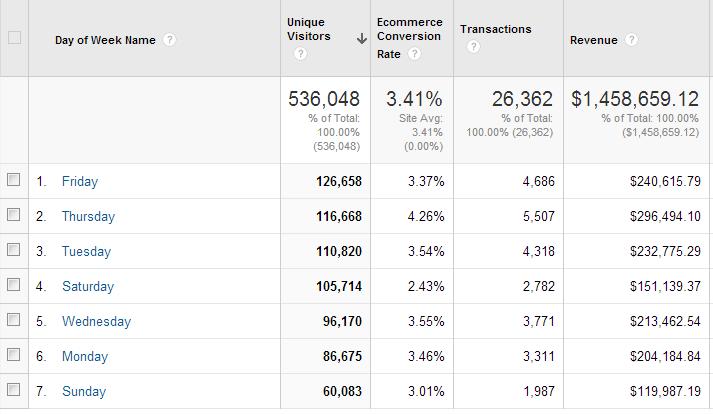

Если эксперимент длится несколько дней, а не полную неделю, вы рискуете получить недостоверные результаты. Посмотрите в Google Analytics отчет по конверсиям в разные дни недели, колебания могут быть значительными. Пример:

Что мы тут видим? В четверг зафиксировано в 2 раза больше конверсий, чем в субботу и воскресенье, и показатель конверсии в четверг практически в два раза выше, чем в субботу.

Если мы не будем проводить эксперимент в течение полной недели, результаты будут некорректны. Итак, вот, что вы должны делать: запускать тесты как минимум на 7 дней. Если результаты не достигнуты за первые 7 дней, продлеваем тест еще на столько же. Если опять нет результата, еще на 7.

Единственный случай, когда можно сделать исключение — если данные показывают, что каждый день конверсия одинакова. Но даже в этом случае, все же лучше выбрать неделю.

Всегда уделяйте внимание внешним факторам, например, сезонность и праздники.

На дворе Рождество? Тест, который вы проводите в это время, может и не показать такие выдающиеся результаты в январе после праздников. Если вы запустили эксперимент в период высокого спроса, то непременно повторите его, когда он закончится. Проводите масштабную рекламную кампанию? Она также может исказить результаты. Внешние факторы всегда влияют на результаты экспериментов. Есть сомнения? Проведите еще один тест.

3.Сплит-тестирование проводится, даже если нет трафика и конверсий

Если у вас 1-2 продажи в месяц, и вы запускаете эксперимент, по результатам которого страница B конвертируется лучше, чем страница А, на 15% — как вы это узнаете? Ведь ничего не изменилось!

Не стоит использовать А/В тестирование для оптимизации конверсии, если у вас мало трафика. Причина заключается в том, что, даже если версия B намного лучше, чтобы получить заметные результаты потребуется много времени.

Вместо этого следует просто перейти на версию В. Без тестирования. Запускаете и смотрите результаты. Идея состоит в том, чтобы получить большой подъем — в 50-100%.

4.Тесты не всегда основаны на гипотезе

Идеи для эксперимента не появляются просто так. Они основываются на гипотезах.

Очень часто бывает так, что компания выбирает в качестве идеи для теста первое, что приходит в голову. И получается что-то вроде эксперимента со спагетти — мы бросаем их в стену, только ради того, чтобы узнать прилипнут они или нет. То есть мы просто тестируем случайную идею.

Случайные идеи обходятся недешево — на них тратится драгоценное время и трафик. Никогда так не делайте. У вас должна быть гипотеза. Что это такое, кстати?

Гипотеза — положение, выдвигаемое в качестве предварительного, условного объяснения некоторого явления или группы явлений; предположение о существовании некоторого явления.

И это не должна быть гипотеза в стиле «спагетти». Необходимо проанализировать и выяснить, какие проблемы могут быть и где, провести исследование, найти причину проблем, одновременно выстраивая гипотезу для их решения.

Если вы тестируете версию А против версии В, не имея четкой гипотезы, и версия В оказывается лучше на 15%, что вы узнаете из этого? Ничего.

Ирина Чернова, руководитель отдела аналитики агентства i-Media:

Ирина Чернова, руководитель отдела аналитики агентства i-Media:

Поддерживаю пункт 4. Гипотеза эксперимента — это самый важный элемент. На начало эксперимента вы должны понимать, за счет чего вы хотите улучшить свою страницу.

Тестирование отвечает на вопрос: да, этот вариант лучше, чем предыдущий вариант. Если гипотеза построена верно, на основе статистики и знаний, то и эксперименты зачастую успешны.

Улучшайте ваши сайты и делайте их более удобными и понятными для пользователей.

5. Данные не отгружаются в Google Analytics

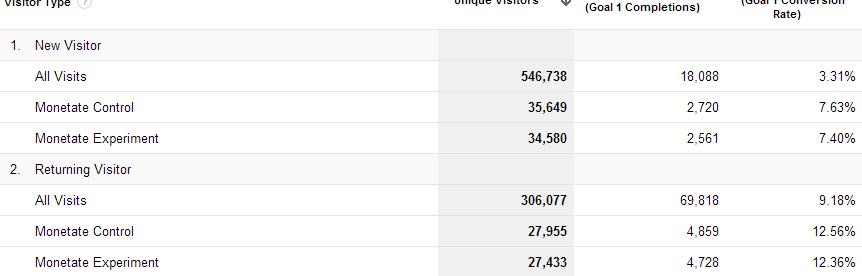

Усредненные цифры всегда врут, не забывайте об этом. Если версия А лучше, чем В на 10%, это далеко не полная картина. Необходимо сегментировать тестовые данные в Google Analytics — чтобы позволит найти важную информацию.

Встроенная сегментация также есть в инструменте Optimizely, но функционал гораздо скромнее, чем в Google Analytics. Visual Website Optimizer позволяет настроить автоматическую выгрузку данных в Google Analytics, которая будет происходить для каждого проводимого теста.

6.Время и трафик тратятся на глупые тесты

Вы тестируете цвета? Остановитесь. Не тратьте время и трафик на бессмысленные эксперименты только потому, что у кого-то это сработало. Тестируйте гипотезы, основанные на реальных данных.

7.Сдаваться после первой неудачной попытки

Мы провели тест, он не получился. Итак, попробуем провести тестирование другой страницы?

Не так быстро. Большинство «первых» тестов проваливаются. Но нужно повторять их. Мы запустили тест. Сделали соответствующий вывод, улучшили нашу гипотезу. Запускайте еще один тест следом, делайте выводы, и улучшайте гипотезу. Затем запустите еще один тест и т.д.

Вот пример компании, которая провела 6 тестов подряд с одной и той же страницей, чтобы получить результат, который их удовлетворит. Именно так и происходит в реальности.

Если думать, что первый тест превзойдет все ожидания, деньги будут потрачены зря и кто-то, возможно, потеряет работу. И это не должно быть так. Просто нужно запускать серию тестов.

8.Непонимание ошибок первого рода

Статистическая значимость — это не единственная вещь, которой нужно уделять внимание. Нужно также понимать ошибки первого рода. Нетерпеливые тестеры захотят пропустить А/В тестирование, и перейти к A/B/C/D/E/F/G/H — например, Google тестировал 41 оттенок синего цвета. Но это не самая хорошая идея. Чем больше вариантов вы тестируете, тем более высока вероятность ошибки первого рода. В случае 41 оттенка синего, даже при 95% статистической значимости шанс ошибки первого рода 88%.

Не тестируйте множество вариантов за 1 раз. Лучше делать простое А/В тестирование — вы быстрее получите результаты, сделаете вывод и улучшите гипотезу.

9.Проведение нескольких тестов одновременно с наложениями трафика

На своем ecommerce сайте вы решили запустить несколько тестов одновременно. Один на странице товара, другой на странице корзины, третий — на главной странице и т.д. Экономим время, не так ли?

Нет. Мы просто искажаем результаты. Если вы хотите тестировать новую версию сразу нескольких страниц — например, главную, страницу товара и чекаута — вы должны использовать многостраничные эксперименты, созданные специально для этого — функционал позволит им видеть либо новые версии для каждой страницы, либо старые варианты, но не чередовать их.

10.Игнорирование небольших достижений

Представим, что по результатам эксперимента тестовый вариант позволяет нам увеличить текущие показатели на 4%. Многие скажут: «Слишком небольшая выгода! Даже не буду напрягаться, чтобы внедрить обновление».

Но дело вот в чем — если сайт хороший, у вас не будет значительных результатов все время. По факту, они случаются очень редко. Если сайт не очень, может быть так, что большинство тестов позволит получать 50%-ное улучшение каждый раз. Но все равно это рано или поздно закончится.

Большинство успешных тестов получают небольшие результаты 1%, 5%, 8%. Иногда даже 1%-улучшение может привести в результате к миллионным доходам. Все зависит от цифр, с которыми мы имеем дело. Но главное вот что — на все нужно смотреть с годовой перспективы.

Один тест — это лишь один тест. Вы будете делать много тестов. Если вы будете увеличивать свою конверсию на 5% каждый месяц, через 12 месяцев первоначальный показатель конверсии вырастет уже на 80%.

Поэтому обращайте внимание на небольшие победы. В конце концов, вы в итоге получите больше.

11.Тесты не проводятся на постоянной основе

День без теста потрачен впустую. Тестирование — это обучение. Новые знания о вашей аудиторией, о том, что работает, а что — нет. Все это можно использовать в маркетинге, контексте и т.д.

Вы не узнаете, что работает, пока вы это не протестируете. Тестам нужны трафик и время.

Это вовсе не значит, что нужно запускать любые тесты, даже плохие. В любом случае нужно тщательное исследование, гипотеза и т.д.

Наталья Чернецова, веб-аналитик агентства интернет-маркетинга SEO-Matik:

Наталья Чернецова, веб-аналитик агентства интернет-маркетинга SEO-Matik:

К перечисленным ошибкам я хочу добавить несколько базовых, от которых в принципе зависит возможность получения результатов.

Первая ошибка — неправильно поставленная задача. У заказчика и исполнителя нет понимания, для чего делать тестирование. В основе каждого тестирования должен находиться маркетинг. Я говорю о точной формулировке бизнес-задач. Улучшения ради улучшений не имеют смысла.

Вторая ошибка — отсутствие систематичности. Исследования проводятся от случая к случаю.

Третья ошибка — нет конверсии знаний в конкретные действия. Заказчик получает анализ, но либо не выполняет рекомендации, либо выполняет их не полностью.

Наконец, четвертая ошибка — тестирование одновременно нескольких элементов. Из-за этого сложно выявить, какое изменение повлияло на конверсию.

Могу сказать, что инструментов для тестирования много, но специалистов, которые способны его провести и обработать данные — мало.

По материалам conversionxl.com

Теги:

Теги: