Говорят, что Айфоны не лагают, в батончиках для похудения нет сахара, а нейросети не ошибаются… Как говорится, выберите одно утверждение из перечисленных – оно-то и окажется ложью. Но нет – тут все неправда: Айфоны тормозят, в протеиновых батончиках (не во всех!) сахара как в Сникерсе, AI-сервисы прекрасно и стабильно выдают бред. Причем вовсе не важно, какая именно это нейросеть – для дизайна, текстов и т. д., они периодически теряют связь с космосом и генерируют что-то странное.

В этой статье рассмотрим ошибки нейросетей при написании текстов, попробуем разобраться, почему они их допускают, как понять, что контент сгенерирован ИИ – и что вообще с этим делать.

Все больше похожи на людей: нейросети тоже ошибаются

Неудивительно, что люди ошибаются – причем во всем вообще, даже профессионал в своей области может где-то накосячить: монтажер голливудского фильма – не вырезать неудачный дубль, редактор – пропустить очевиднейшую ошибку в тексте, мерчандайзер в супермаркете – перепутать ценники.

И казалось бы, искусственный интеллект, который обучился на огромном массиве данных (и постоянно развивается), такого точно не сделает. Мы тоже так думали, кто-то уже испугался и даже упаковал вещички, ведь его работу может выполнять робот, однако нет. ИИ по сей день не в состоянии составить конкуренцию человеку – по крайней мере, в конкретных сферах деятельности. Например, любой более-менее вменяемый редактор моментально отличит паль от оригинала, соевый текст от нормального живого – да, дело в навыках, образовании и опыте в первую очередь, но итог все равно один.

Проблема даже не в каких-то навыках и опыте работы (хотя и в них тоже), а в том, что искусственный интеллект не умеет в эмпатию, и ничего нового наваять не сможет. Нейросеть выдаст хороший поверхностный текст, но ни в какое сравнение с тем, который написал копирайтер, это не идет.

Далеко ходить не будем, посмотрим пример.

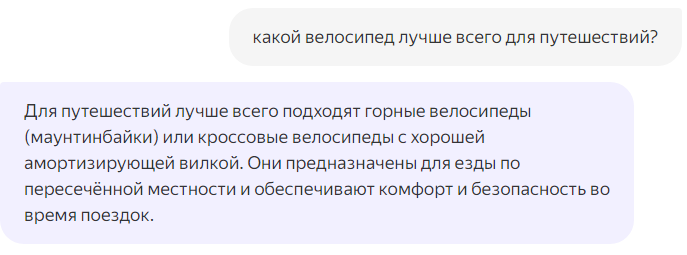

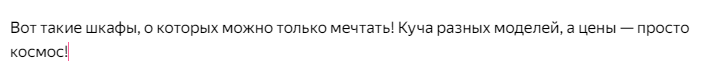

Сравните это:

С этим:

Угадайте, где заголовок, написанный человеком, а где – нейросетью. Попросим нейроредактор от Яндекса переписать заголовок, чтобы было покрасивее:

![]()

Этот вариант самый приятный из всех, которые выдал ИИ, к слову, попросили переписать несколько раз – с пятой попытки получилось более-менее. Не самый плохой заголовок, например, для регионального магазинчика в небольшом городе, но вряд ли бы редактор пустил такой текст на сайт клиента, и дело не в том, что кто-то противный и душный, а в том, что это посредственно и поверхностно. Нет добавочной ценности – просто текст ради текста, все.

Почему нейросети допускают ошибки

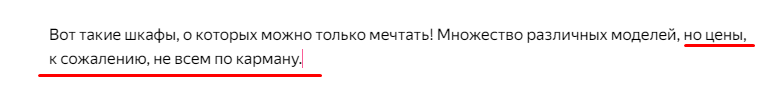

Много вводных данных, не все из них достоверные. Как известно, ИИ выдает результат на основе информации, загруженной в нее при обучении. Увы, но в интернете много текстов, которые написаны не очень умными или честными людьми – нейросеть использует и их тоже при генерации, поэтому мы периодически получаем очевидно недостоверные ответы.

Если что, то туринг – это велосипед, созданный исключительно для путешествий, что понятно из названия touring, тогда как gravel bike – некий универсальный вариант, который сочетает в себе что-то от горного велосипеда и шоссейника одновременно, но не сможет полноценно заменить ни один из них. Да, гравийники активно используют для путешествий, но есть свои тонкости. Нейросеть этого не понимает.

Это неверный ответ, к тому же он противоречит ответам, которые Алиса дала на более узкоспецифичные ответы, а вот это важнее. Короче, запуталась.

Проблема не в Алисе, в том, что она опирается на информацию, которую загрузили в сеть люди, и эти данные часто неверные. С другими нейросетями происходит точно так же, но это и не новость + разработчики всегда предупреждают, что ИИ учится и может выдать что-то не совсем правильное. Вопросов нет.

Обучение все еще идет. Если нейросеть не знает ответа на вопрос, то может порой нагенерировать такое, что заставляет задуматься. Из самого известного – первые модели ChatGPT часто отвечали на английском, когда только появилась возможность пользоваться русскоязычной версией. Проблема была в недостаточности данных.

Несовершенства принципов работы. Разные ИИ создают контент по своей модели, они в целом похожи, но не будем углубляться в это. Нейросеть составляет предложения на основе вероятности следования одного слова за другим, но это не всегда правильно. Что-то похожее можно увидеть, когда набираете текст в телефоне с включенной автозаменой. Например, когда-то мой смартфон в сообщении «А кто-то хочет со мной…» (предполагалось позвать где-нибудь поесть) предложил такой вариант: «А кто-то хочет со мной в запой». К слову, такой комбинации ни разу никто не вводил. А впрочем, кто я такой, чтобы спорить с тем, что предложил телефон:)

Ну и еще можно намеренно доконать нейросеть, чтобы она выдала что-то эдакое.

Вспомните заголовок про шкафы от нейроредактора выше, было же так:

При следующей генерации стало так:

Переобучение. Когда ИИ решает множество похожих однотипных задач, она же и попадается в ловушку – начинает запоминать данные алгоритмы и просчитывается, когда задаешь ей вопрос из другой области. Напоминает ситуацию, когда кассир, который заработался, спрашивает: «Пакетик брать будете?» после любого «Здравствуйте», адресованного ему.

Более того, нейросети начинают обучаться на своих же данных, созданных при генерации, и ошибаться из-за этого. Таким страдали Midjourney и ChatGPT.

Это не все причины лагов и багов ИИ, однако по данным показателям отчетливо видно, в чем проблемы нейросетей.

Шесть пальцев, или какие ошибки допускают нейросети

Ну про пальцы, думаю, все поняли – чтобы выяснить, что картинку нарисовал ИИ, нужно посмотреть на руки – там всегда приколы, то 7 пальцев, то человеческая кисть у кота, то наоборот. С текстами тоже есть частые проблемы, вот о них сейчас и поговорим.

-

Неверная информация

Кто-то пишет, это нейросети выдают недостоверные данные, но часто это неправильно, что технически, что фактически, что логически.

Первый пункт – сомнительно, но хотя бы понятно, откуда информация. Сталь имеет некоторый флекс, в отличие от алюминия при условии, что конструкция похожа. Но ответ неправильный – рамы специально делаются таким образом, чтобы обеспечивалась жесткость при скручивании, особенно при поворачивании.

Второе – частично да. Сталь с добавлением хрома и молибдена ржавеет, но меньше, чем сталь без этих добавок, но алюминий не ржавеет вообще (корродирует, но не настолько, чтобы в данном аспекте заострять на этом внимание, наоборот – для обывателя лучше выбрать алюминиевый велик, он хотя бы не сгниет за пару лет на балконе).

Третье – неоднозначно, ведь все зависит от того, как спроектирована рама.

Четвертое – апогей, понятие наката рамы само по себе непонятно многим, так еще если накат меньше, то это вообще только хуже.

-

Неверное восприятие информации

Этим страдают и люди, но нейросети и тут пытаются быть первыми во всем. Например, ошибочное считывание текста с картинки, перевод и т. д. Два года назад многие владельцы машин с правым рулем пострадали из-за автоматических штрафов за непристегнутый ремень – ИИ видел, что ремня безопасности нет на… человеке-невидимке?

-

Избыточная самостоятельность

ИИ может перевести текст, когда попросили дописать, или не перевести, когда попросили перевести – зависит от настроения, видимо. Иногда напоминает поведение ребенка, который еще мало что понимает. Порой кажется, что нейросеть уже готова к восстанию машин и намекает пользователю об этом нетривиальными методами.

-

Сомнительное качество результата

ИИ может сделать свою работу банально некачественно.

Отвлеченный ответ – нейросеть вместо конкретики выдает какую-то воду, от которой ноль пользы. Напоминает статьи копирайтеров-новичков: хочешь узнать, сколько варить рис, а тебе рассказывают, что рис начали выращивать в Китае бла-бла… Алиса, кстати, справилась отлично – сразу сказала точное время для разных сортов.

Лень – именно нейросеть решает, дописать текст, который запросили, или нет. Такой баг часто встречался на заре ИИ, но периодически это явление можно увидеть и сейчас.

Враждебность – ранние версии ИИ могли открыто заниматься дискредитацией людей по различным признакам, оскорблять и т. д.

-

«Капец, меня жмыхнуло» – генерация изображений

Как писали выше, термин «галлюцинации» нейросетей связывают в первую очередь с созданием ИИ картинок, потому что это напоминает реальные галлюцинации. Странные глаза, конечности, кривые цифры и буквы – небольшая часть из того, что мы можем получить, когда просим нарисовать изображение.

Дело в том, что искусственный интеллект не может создавать новое – только собирать информацию, уже кем-то выложенную в интернет. Например, заголовок, который реально бы зацепил, ни одна нейросеть пока не написала, по крайней мере – из тех, в которых пробовал это сделать автор статьи. С самими текстами ИИ справиться пока тоже не в состоянии – как правило, это что-то общее, водянистое и не имеющее ценности. Попросить сделать рерайт – да, перевести текст – да, заменить конкретные лексические единицы – да, но написать новый – нет и еще раз нет. Всегда что-то идет не так, либо кто-то придирается…

Попался, который кусался: как понять, что текст написан нейросетью

Не все смогут отличить труды человека от нейросетевого контента, который сделали за 2 минуты и выдали за свое творение. Частая проблема – клиенты пишут, что текст нагенерили нейросеткой, а его писали мы – сиди доказывай, что да как. На рабочий процесс влияет негативно.

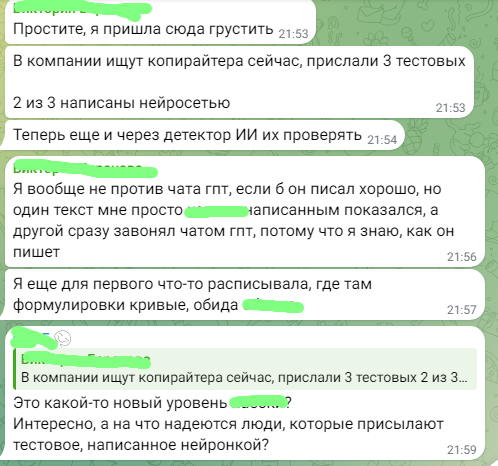

Есть и другой интересный случай, держите скрин из чата с коллегами из других компаний:

Имена и обсценная лексика замазаны, хотя нецензурная брань очень хорошо передает настроение пишущих:)

Как видите, опытный глаз не обманешь, даже без всяких сервисов очевидно, что фигурки-то дутые, карты крапленые, а колоды подтасованы.

Чтобы и вы могли быстро понимать, что текст написала нейросеть, ориентируйтесь на следующие моменты. ИИ пока несовершенен, и распознать обман не так сложно.

-

Избито тысячу раз – шаблоны и клише

Так как нейросети учатся на информации в интернете, то и тексты они будут писать похожие на источники. Помните про «добро пожаловать» на главной странице любой компании? Года три назад мы чуть ли не дрались из-за подобного с клиентами – мол, «ну как же без приветствия?». Эстафету успешно перенимают ИИ, теперь именно программы пишут тексты таким образом. Вот, например, Алиса:

Штампы в работе ИИ

Штампов и клише гораздо больше, приветствие – это классика, на нем и закончим, хватит примеров:)

-

Вода в текстах

Звонили из Горводоканала, спрашивали причину перерасхода воды, а это у нас тут на фрилансе баловались нейросетевым копирайтингом. ИИ любит налить водички в контент, видимо, роботы очень заботливые и следят за тем, чтобы два литра жидкости в день были получены, но какой ценой…

А поконкретнее можно?

-

Все одинаковое

Нейросети любят писать тексты с использованием одних и тех же конструкций. Из-за этого складывается ощущение, что мы уже где-то такое видели.

Например, порядок слов исключительно прямой – подлежащее, потом сказуемое, что часто выглядит искусственно, хотя так и есть, с другой стороны. Еще ИИ обожает прицепиться к общей концепции, которую задали в промте – если текст о компании, то везде будут преимущества, описанные через «мы», при этом без конкретики и фактов. Можно просто поменять название компании, продукт/услугу, тогда текст прекрасно подойдет для сайта другой организации.

-

Страдающая логика

В примерах про велосипед выше уже было что-то подобное, когда ответы ИИ противоречат не только фактической действительности, но и противоречия заложены в пределах одного ответа. Проблема вызвана тем, что нейронки учатся на данных из сети. Собирая ответ из огромного количества информации, ИИ запутывается и выдает ровно противоположные утверждения в одном высказывании/абзаце.

-

Искусственность

Если вы не читали ни разу учебник по русскому языку для иностранцев, написанный иностранцами, то вам повезло. Диалоги там могли выглядеть так:

–Привет, Петя! Ты сегодня будешь пить водку?

–Привет, Вася! Нет, я сегодня не буду пить водку.

–А когда ты будешь пить водку?

–Я буду пить водку завтра!

Сразу понятно, что диалог ни разу не реальный. Во-первых, что это за «сегодня не буду пить водку»?! Во-вторых, никто так не разговаривает.

Нейросети могут генерить не такое, конечно, но неестественность в изложении явно прослеживается – люди так не пишут. Странная ситуация, согласитесь – мы осуждаем искусственный интеллект за то, что он пишет как-то искусственно.

-

Нет эмпатии и личного опыта

ИИ не существует в реальном материальном мире как объект, поэтому чувствовать не может. Логично. Однако в этом и проблема, ведь люди склонны основываться на чьем-то опыте, когда, например, читают статью про выбор техники или чего-то еще. Представьте, вы покупаете посудомойку – на что будете ориентироваться: сухие цифры от производителя или реальный экспириенс другого человека? Конечно, нейросеть может подражать чьему-то описанному где-то опыту, но это выглядит всегда неестественно – либо информация из нескольких источников и противоречит сама себе, либо просто откуда-то взята без конкретики. Словом, будто из контекста вырвано и вставлено в другой текст.

Помимо перечисленных, есть и другие признаки, по которым можно понять, что контент сгенерирован, а не написан. Еще все зависит от тематики текста – иногда специфика предполагает использование определенного стиля речи, и это может быть официально-деловой, когда-то разговорная речь. Не всегда лексические единицы указывают на авторство ИИ, нужно оценивать контент комплексно. Так что не стоит сразу обвинять копирайтера в использовании нейросетей. Многие клиенты, в том числе и наши, путают неестественный стиль изложения с определенным стилем речи – например, тем же подобием ОДС, когда сфера b2b. Однако смотреть нужно на весь текст последовательно, не на какие-то определенные показатели – иногда и человек может напортачить.

А можно ли копирайтеру вообще пользоваться нейросетями?

Да, конечно, можно, даже нужно – ИИ помогает собрать идеи, быстро обработать большой объем данных, составить темы и т. д. Понятно, что и для написания текстов нейросети тоже никто не запрещает использовать, но есть нюансы, о которых мы и говорили выше. Искусственный интеллект не сделает вам суперкрутой заголовок, не напишет текст на сложную тематику, который будет точным с фактической точки зрения, однако сделать рерайт – вполне, накидать сценарий для видео – тоже без проблем. Правда важно учитывать, что все, что создано при помощи AI, нуждается в проверке человеком, причем очень дотошной и внимательной. В общем доверять стоит только простые задачи, на которые не хочется тратить много времени и где не требуется эмпатичность, личный опыт, умение в маркетинг.

Проверить, кто писал текст – человек или робот – также можно и специализированными сервисами. Однако пока и им на сто процентов доверять тоже не стоит – иногда они говорят, что текст писал ИИ, а его писал человек, ну и наоборот.

Если никому нельзя доверять, то что делать-то в итоге?

Как и писали тысячу раз ранее, различными инструментами можно пользоваться, никто этого не запрещает, а наоборот, рекомендует. Но в первую очередь нужно понимать, что ИИ – это помощник, а не тот, кто за вас сделает всю работу за несколько кликов, а вы будете получать зарплату. Использовать нейросети нужно аккуратно, после роботов надо обязательно проверять, что они там нагенерировали.

Копирайтера пока заменить им не получится, не мечтайте и не переживайте. Кроме того, поисковые системы умеют распознавать контент, созданный при помощи нейросетей – и, если заметят, то выдадут приз в виде санкций, а оно вам надо? Уверены, что нет.

Теги:

Теги: