19 Мая 2009 в 12:45

Nigma.ru индексирует сайты по-новому

0

3738

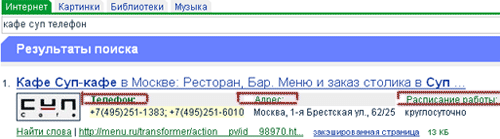

Nigma.ru разработала . Технология разработана и запущена в тестовом режиме, сейчас новые результаты поиска выдаются примерно на 1% пользовательских запросов. Однако уже по первым подсчетам видно, что пользователи кликают на информационные блоки в два раза чаще, чем на обычные результаты поиска, т.е. релевантность выдачи стала существенно выше.

Идея нового алгоритма в том, что весь контент web-страниц расщепляется на информационные блоки. Затем блоки с информацией, связанной с запросом пользователя, подмешиваются в результаты поиска с более высоким приоритетом.

База у алгоритма еще экспериментальная, на данный момент проиндексировано около одного миллиона страниц Рунета. Уже к концу лета разработчики Nigma.ru планируют расширить инфоиндекс до сотен миллионов страниц.

Появление новой технологии стало возможным, так как значительно увеличилось число сайтов, которые наполняются информацией автоматически с помощью скриптов и шаблонов на основе баз данных.

«Так как объемы структурированной информации в Интернете растут, то поисковик, который сможет обрабатывать и использовать информацию о структуре веб-страниц, будет работать гораздо лучше, чем обычные поисковые системы», - отмечает Гектор Гарсия Молина, научный руководитель проектов Nigma.ru со стороны Стэнфорда. Ранее г-н Молина был руководителем Проекта Электронной Библиотеки Стенфорда, в рамках которого была разработана поисковая машина Google.

По оценкам Дэвида Эксмарка, одного из основателей самой популярной системы управления базами данных MySQL, сейчас такие страницы составляют не менее 80% всех страниц Интернета.

Теги:

Теги: